言語AIが多様な化合物構造を学習する過程の特徴を発見 化学言語モデルとしてのTransformerはキラリティの認識を苦手とする 研究成果

東京大学大学院薬学系研究科の吉開泰裕大学院生、水野忠快助教らによる研究グループは、深層学習モデルが多様な化合物構造を学習する際に苦手とする構造を明らかにしました。

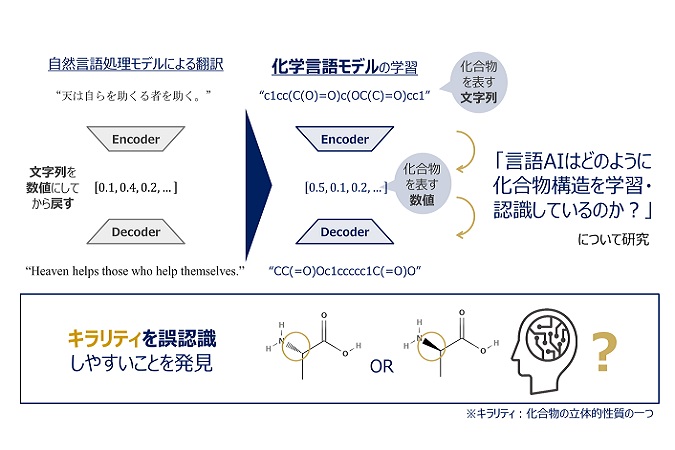

深層学習モデルは現在創薬分野でも盛んに応用されています。特に近年は、自然言語処理を援用するアプローチが頻用されていますが、深層学習モデルがどのように多様な化合物構造を学習・認識しているかは明らかとなっていませんでした。本研究グループは、代表的な深層学習モデルであるTransformerが多様な化合物構造を学習していく過程を、モデルが認識している部分的な構造に着目して精査しました。結果、Transformerモデルが化合物の立体的な性質の一つであるキラリティを誤って認識しやすいことなどを発見しました。本研究成果は2月16日、国際科学誌Nature Communicationsに掲載されました。

深層学習モデルは現在創薬分野でも盛んに応用されています。特に近年は、自然言語処理を援用するアプローチが頻用されていますが、深層学習モデルがどのように多様な化合物構造を学習・認識しているかは明らかとなっていませんでした。本研究グループは、代表的な深層学習モデルであるTransformerが多様な化合物構造を学習していく過程を、モデルが認識している部分的な構造に着目して精査しました。結果、Transformerモデルが化合物の立体的な性質の一つであるキラリティを誤って認識しやすいことなどを発見しました。本研究成果は2月16日、国際科学誌Nature Communicationsに掲載されました。

論文情報

Yasuhiro Yoshikai, Tadahaya Mizuno*, Shumpei Nemoto, Hiroyuki Kusuhara, "Difficulty in chirality recognition for Transformer architectures learning chemical structures from string representations," Nature Communications: 2024年2月16日, doi:10.1038/s41467-024-45102-8.

論文へのリンク (掲載誌 )

)